Kapitel III: Bedingte Wahrscheinlichkeit und stochastische Unabhängigkeit

III.1 Wiederholung: Mehrstufige Zufallsexperimente

Baumdiagramm und Pfadregeln

Ein Baumdiagramm stellt ein mehrstufiges Zufallsexperiment übersichtlich dar. An jedem Ast steht die Wahrscheinlichkeit für diesen Ausgang.

Pfadregel 1 (Produktregel): Die Wahrscheinlichkeit eines Ergebnisses ist das Produkt aller Wahrscheinlichkeiten entlang des Pfades:

Pfadregel 2 (Summenregel): Die Wahrscheinlichkeit eines Ereignisses ist die Summe der Wahrscheinlichkeiten aller zugehörigen Pfade:

Ziehen ohne Zurücklegen als Übergang

Beim Ziehen ohne Zurücklegen hängt die Wahrscheinlichkeit im zweiten Zug davon ab, was im ersten Zug gezogen wurde — das Ergebnis des ersten Zugs verändert die Ausgangssituation.

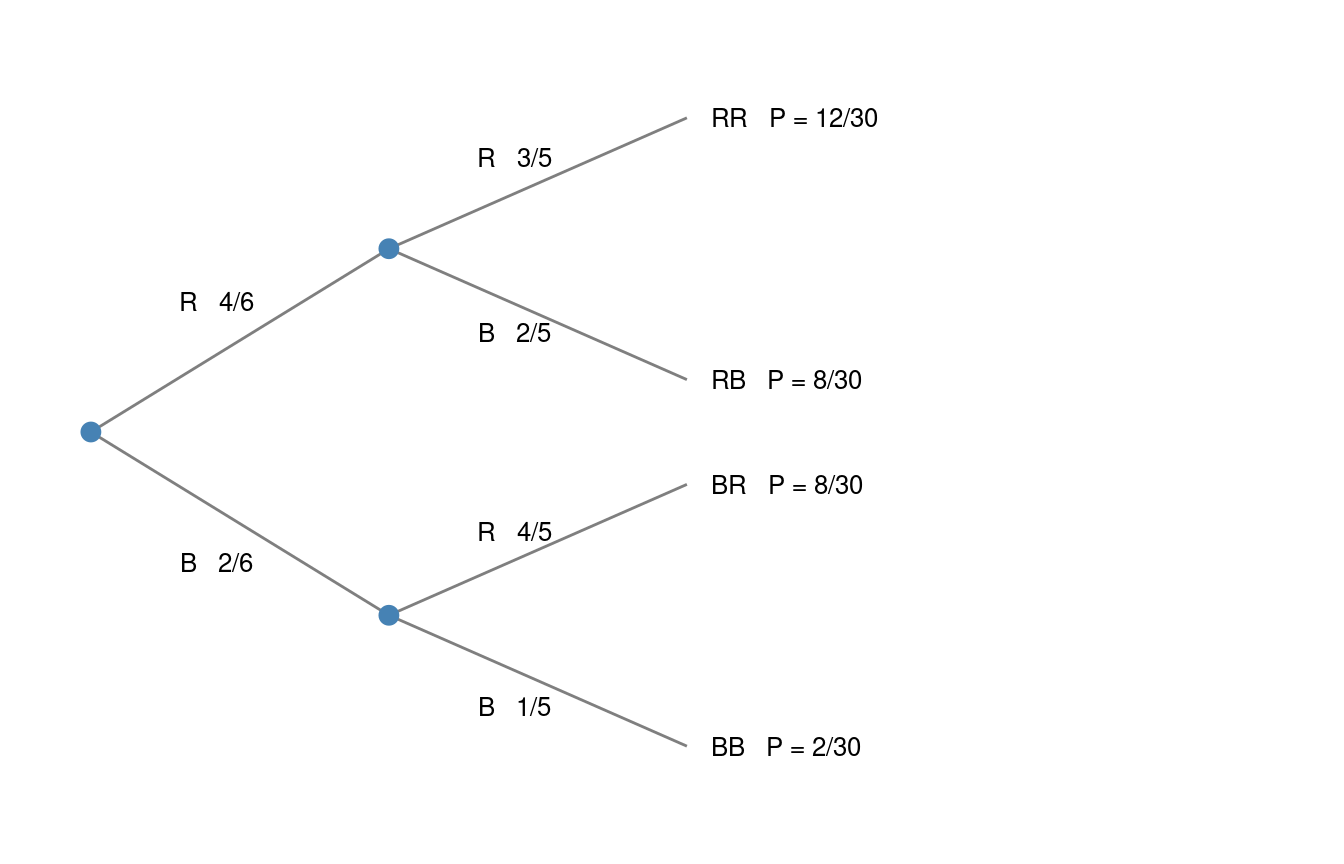

Beispiel: Urne mit 4 roten (R) und 2 blauen (B) Kugeln, zweimaliges Ziehen ohne Zurücklegen:

Die Übergangswahrscheinlichkeiten im zweiten Zug (, , , ) sind bereits bedingte Wahrscheinlichkeiten — das ist die zentrale Idee dieses Kapitels.

Gegenereignis

Für jedes Ereignis gilt:

III.2 Bedingte Wahrscheinlichkeit

Motivation

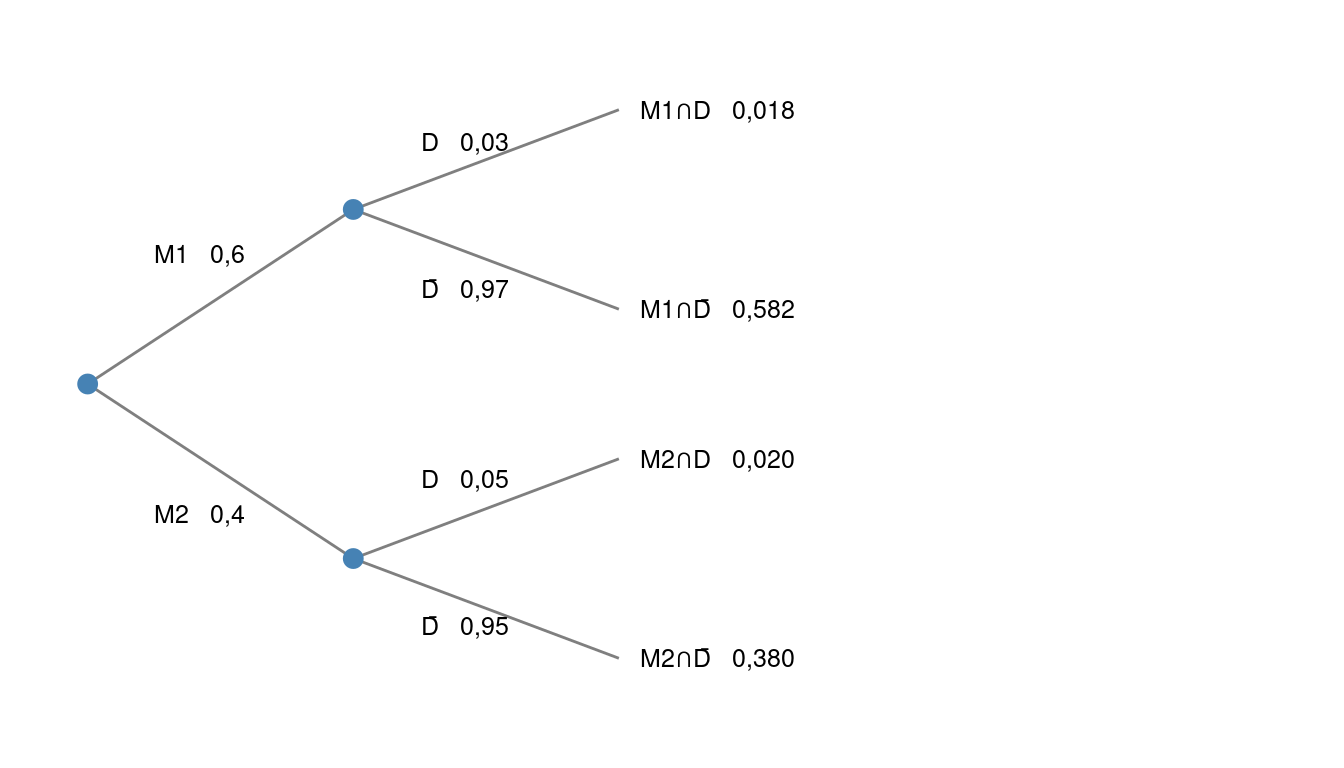

Situation: In einer Fabrik produzieren zwei Maschinen Bauteile. Maschine M1 liefert aller Teile, Maschine M2 liefert . Von den Teilen aus M1 sind defekt, von denen aus M2 sind defekt.

Ein zufällig ausgewähltes Teil ist defekt. Wie groß ist die Wahrscheinlichkeit, dass es von M1 stammt?

Um diese Frage zu beantworten, benötigt man die bedingte Wahrscheinlichkeit.

Definition

Die bedingte Wahrscheinlichkeit von unter der Bedingung — geschrieben — gibt an, wie wahrscheinlich ist, wenn bereits bekannt ist, dass eingetreten ist:

Andere Schreibweise: (lies: „Wahrscheinlichkeit von gegeben “)

Multiplikationssatz

Umgestellt ergibt die Definition den Multiplikationssatz:

Das ist genau die Pfadregel 1 — die Äste im Baumdiagramm zeigen immer bedingte Wahrscheinlichkeiten.

Bedingte Wahrscheinlichkeit im Baumdiagramm

Im Baumdiagramm lässt sich direkt ablesen: Es ist die Übergangswahrscheinlichkeit am Ast von zu .

Aus dem Baum lässt sich direkt ablesen: - - (Ast-Beschriftung) -

Unterschied zwischen , und

Diese drei Größen sind im Allgemeinen verschieden und beschreiben unterschiedliche Sachverhalte:

| Größe | Bedeutung | Wert im Beispiel |

|---|---|---|

| Teil stammt von M1 und ist defekt | ||

| Teil ist defekt, gegeben es stammt von M1 | ||

| Teil stammt von M1, gegeben es ist defekt |

Die letzte Größe berechnen wir in III.5.

III.3 Vierfeldertafel

Die Vierfeldertafel ist eine kompakte Darstellung aller Wahrscheinlichkeiten für zwei Ereignisse und sowie und .

Aufbau

Jede Zeile und Spalte summiert sich auf den Rand — daher heißen die Summen Randwahrscheinlichkeiten.

Befüllen der Vierfeldertafel

Im Fabrik-Beispiel mit , (defekt):

Vorgehen: Bekannte Werte eintragen, fehlende durch Addition/Subtraktion ergänzen.

Bedingte Wahrscheinlichkeiten ablesen

Aus der Vierfeldertafel lassen sich bedingte Wahrscheinlichkeiten direkt berechnen:

Vierfeldertafel mit absoluten Häufigkeiten

Statt Wahrscheinlichkeiten können auch absolute Häufigkeiten eingetragen werden (z.B. bei Umfragen). Die Berechnung bedingter Wahrscheinlichkeiten funktioniert gleich:

Beispiel: In einer Schulklasse von 30 Schülerinnen und Schülern: 18 haben ein Haustier (), 12 nicht. Von den 18 mit Haustier sind 14 auch in einem Sportverein ().

Übergang zwischen Baumdiagramm und Vierfeldertafel

Beide Darstellungen sind äquivalent — man kann jederzeit zwischen ihnen wechseln:

- Baum → Tafel: Pfadwahrscheinlichkeiten in die inneren Felder eintragen, Ränder summieren

- Tafel → Baum: Randwahrscheinlichkeiten als erste Stufe, bedingte Wahrscheinlichkeiten () als zweite Stufe

III.4 Stochastische Unabhängigkeit

Definition

Zwei Ereignisse und heißen stochastisch unabhängig, wenn das Eintreten von die Wahrscheinlichkeit von nicht verändert:

Das bedeutet: Ob eingetreten ist oder nicht — tritt mit derselben Wahrscheinlichkeit ein.

Äquivalente Bedingung

Aus der Definition folgt mit dem Multiplikationssatz eine praktischere Formulierung:

Diese Bedingung ist symmetrisch: Wenn und unabhängig sind, gilt automatisch auch .

Unabhängigkeit rechnerisch prüfen

Vorgehen: berechnen und mit vergleichen.

Beispiel: Zweimaliges Werfen einer fairen Münze. = „erstes Mal Kopf”, = „zweites Mal Kopf”.

→ und sind unabhängig.

Gegenbeispiel: Ziehen ohne Zurücklegen (s. III.1). Sei = „erste Kugel rot”, = „zweite Kugel rot”.

→ und sind abhängig (wie erwartet: was man zuerst zieht, beeinflusst den zweiten Zug).

Unabhängigkeit vs. Unvereinbarkeit

Ein häufiger Denkfehler: Unabhängigkeit und Unvereinbarkeit sind nicht dasselbe.

| Unabhängig | Unvereinbar | |

|---|---|---|

| Bedingung | ||

| Bedeutung | beeinflusst nicht | und können nicht gleichzeitig eintreten |

| Beispiel | zwei Münzwürfe | „Kopf” und „Zahl” beim selben Wurf |

Zwei unvereinbare Ereignisse mit und sind niemals unabhängig — denn wenn eintritt, kann nicht eintreten, also .

III.5 Schlussfolgerungen und Dateninterpretation

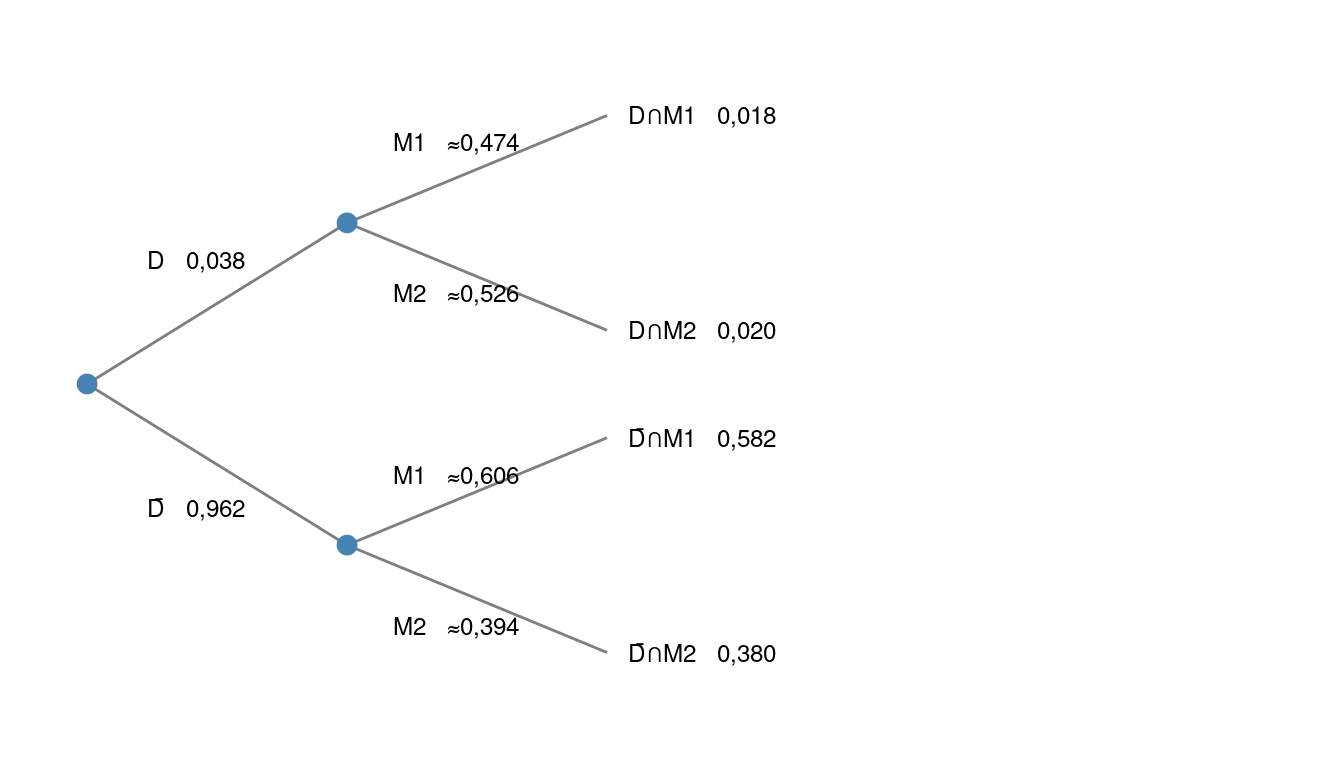

Umkehrung des Baumdiagramms

Oft kennt man die Wahrscheinlichkeiten „vorwärts” (z.B. ), gesucht ist aber die Wahrscheinlichkeit „rückwärts” (). Die Formel dafür ist:

Das ist die einfache Form des Satzes von Bayes.

Der Nenner lässt sich über alle vollständigen Alternativen berechnen (Satz der totalen Wahrscheinlichkeit):

Durchgeführtes Beispiel: Fabrik

Gesucht: — wie wahrscheinlich ist es, dass ein defektes Teil von Maschine M1 stammt?

Aus dem Baumdiagramm (III.2):

Obwohl M1 eine geringere Defektrate hat ( gegenüber ), produziert sie mehr Teile insgesamt — daher stammen fast der Defekte von ihr.

Medizinischer Test — ein klassisches Beispiel

Ein Schnelltest auf eine Krankheit hat folgende Eigenschaften: - Sensitivität : Von Kranken zeigt der Test positiv. - Spezifität : Von Gesunden zeigt der Test negativ. - Prävalenz : der Bevölkerung ist tatsächlich krank.

Gesucht: Wie wahrscheinlich ist es, wirklich krank zu sein, wenn der Test positiv ausfällt? ()

Trotz positivem Test ist man nur mit etwa Wahrscheinlichkeit tatsächlich krank — weil die Krankheit selten ist. Dieses Phänomen heißt Basisrateneffekt (engl. base rate fallacy).

Korrelation und Kausalität

Statistische Daten zeigen oft Korrelationen — zwei Merkmale treten gemeinsam häufig auf. Das bedeutet aber nicht, dass eines das andere verursacht.

Klassisches Beispiel: In Städten mit mehr Kirchen gibt es mehr Verbrechen. Erklärung: Größere Städte haben sowohl mehr Kirchen als auch mehr Verbrechen — die Stadtgröße ist die gemeinsame Ursache.

Grundsatz: Korrelation Kausalität

Kritische Bewertung statistischer Aussagen

Beim Lesen von Statistiken und Studien sind folgende Fragen wichtig:

- Stichprobe: Ist sie repräsentativ? Wie groß ist sie?

- Erhebung: Wie wurden die Daten erhoben (Selbstauskunft, Messung, …)?

- Absolute vs. relative Zahlen: „Doppeltes Risiko” klingt dramatisch — aber von auf ist kaum relevant.

- Kausalität: Wird ein kausaler Zusammenhang behauptet, obwohl nur eine Korrelation vorliegt?

- Grundgesamtheit: Gilt das Ergebnis wirklich für die interessierende Gruppe?

Rückblick: Wichtige Formeln

| Darstellung | Stärke |

|---|---|

| Baumdiagramm | Mehrstufige Abläufe, bedingte Wahrscheinlichkeiten an den Ästen |

| Vierfeldertafel | Übersicht über alle vier Kombinationen zweier Ereignisse |